各製品の資料を入手。

詳細はこちら →Apache Airflow でPipedrive のデータに連携したワークフローを作る

CData JDBC Driver を使ってApache Airflow からPipedrive のデータにアクセスして操作します。

最終更新日:2022-09-07

この記事で実現できるPipedrive 連携のシナリオ

こんにちは!ドライバー周りのヘルプドキュメントを担当している古川です。

Apache Airflow を使うと、データエンジニアリングワークフローの作成、スケジューリング、および監視を行うことができます。CData JDBC Driver for Pipedrive と組み合わせることで、Airflow からリアルタイムPipedrive のデータに連携できます。 この記事では、Apache Airflow インスタンスからPipedrive のデータに接続してクエリを実行し、結果をCSV ファイルに保存する方法を紹介します。

最適化されたデータ処理が組み込まれたCData JDBC Driver は、リアルタイムPipedrive のデータを扱う上で高いパフォーマンスを提供します。 Pipedrive にSQL クエリを発行すると、CData ドライバーはフィルタや集計などのPipedrive 側でサポートしているSQL 操作をPipedrive に直接渡し、サポートされていない操作(主にSQL 関数とJOIN 操作)は組み込みSQL エンジンを利用してクライアント側で処理します。 組み込みの動的メタデータクエリを使用すると、ネイティブのデータ型を使ってPipedrive のデータを操作および分析できます。

Pipedrive への接続を構成する

組み込みの接続文字列デザイナー

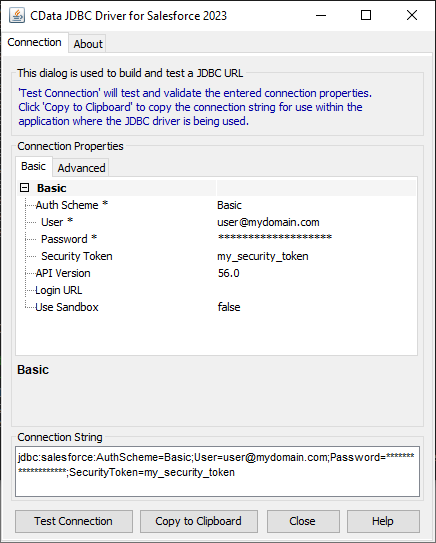

JDBC URL の作成の補助として、Pipedrive JDBC Driver に組み込まれている接続文字列デザイナーが使用できます。JAR ファイルをダブルクリックするか、コマンドラインからjar ファイルを実行します。

java -jar cdata.jdbc.pipedrive.jar

接続プロパティを入力し、接続文字列をクリップボードにコピーします。

Pipedrive 接続プロパティの取得・設定方法

Pipedrive には、接続および認証する2つの方法があります。Basic およびOAuth です。

Basic 認証

Basic 認証で認証するには:- API トークンを取得します。

- Pipedrive ポータルを開きます。

- ページ右上のアカウント名をクリックします。Pipedrive はドロップダウンリストを表示します。

- 会社設定 -> Personal Preferences -> API -> Generate Token に移動します。

- 生成されたAPI トークンの値を記録します。また、CompanyDomain を控えておきます。これは、PipeDrive ホームページのURL に表示されます。(これは会社の開発者用サンドボックスのURL です。)

- 次の接続プロパティを設定します。

- APIToken:取得したAPI トークンの値。

- CompanyDomain:開発者サンドボックスURL のCompanyDomain。

- AuthScheme:Basic。

- 承認されたユーザー名とパスワードでログインします。

API トークンはPipedrive ポータルに保存されます。これを取得するには、会社名をクリックし、ドロップダウンリストを使用して会社設定 -> Personal Preferences -> API に移動します。

OAuth 認証

ユーザー名やパスワードへのアクセスを保有していない場合や、それらを使いたくない場合にはOAuth ユーザー同意フローを使用します。認証方法については、ヘルプドキュメントの「OAuth 認証」セクションを参照してください。

クラスタ環境またはクラウドでJDBC ドライバーをホストするには、ライセンス(フルまたはトライアル)およびランタイムキー(RTK)が必要です。本ライセンス(またはトライアル)の取得については、こちらからお問い合わせください。

以下は、JDBC 接続で要求される必須プロパティです。

| プロパティ | 値 |

|---|---|

| Database Connection URL |

jdbc:pipedrive:RTK=5246...;AuthScheme=Basic;CompanyDomain=MyCompanyDomain;APIToken=MyAPIToken;

|

| Database Driver Class Name | cdata.jdbc.pipedrive.PipedriveDriver |

Airflow でJDBC 接続を確立する

- Apache Airflow インスタンスにログインします。

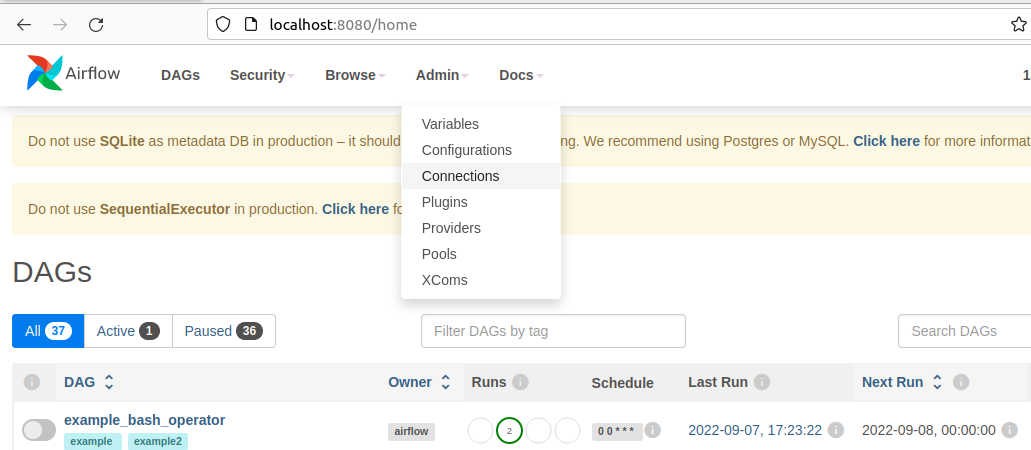

- Airflow インスタンスのナビゲーションバーで、「Admin」にカーソルを合わせ、「Connections」をクリックします。

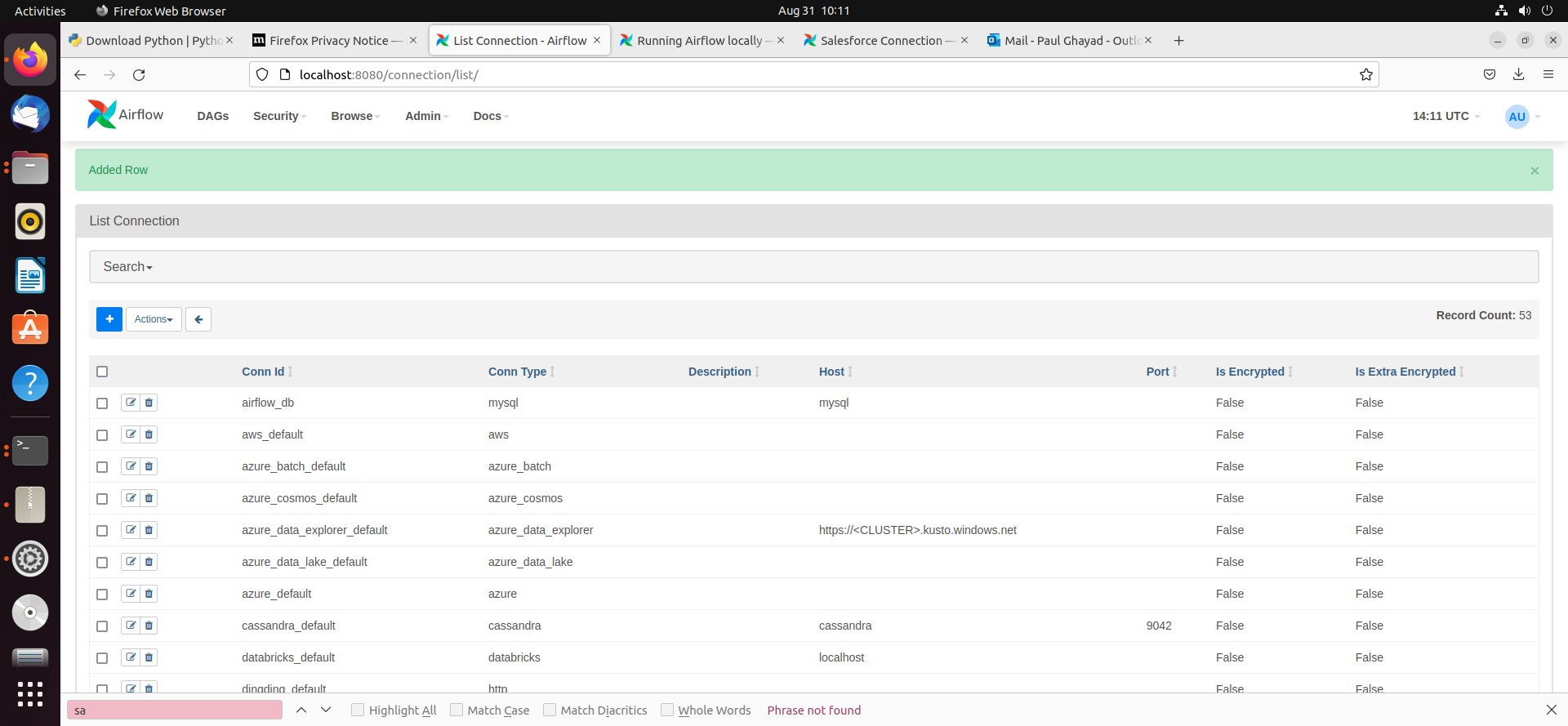

- 次の画面で「+」マークをクリックして新しい接続を作成します。

- Add Connection フォームで、必要な接続プロパティを入力します。

- Connection Id:接続の名前:pipedrive_jdbc

- Connection Type:JDBC Connection

- Connection URL:上記のJDBC 接続URL:

jdbc:pipedrive:RTK=5246...;AuthScheme=Basic;CompanyDomain=MyCompanyDomain;APIToken=MyAPIToken; - Driver Class:cdata.jdbc.pipedrive.PipedriveDriver

- Driver Path:PATH/TO/cdata.jdbc.pipedrive.jar

- フォームの下にある「Test」ボタンをクリックし、新規の接続をテストします。

- 新規接続を保存すると、新しく表示される画面に、接続リストに新しい行が追加されたことを示す緑のバナーが表示されます。

DAG を作成する

Airflow におけるDAG は、ワークフローのプロセスを格納するエンティティであり、DAG にトリガーを設定することでワークフローを実行することができます。 今回のワークフローでは、シンプルにPipedrive のデータに対してSQL クエリを実行し、結果をCSV ファイルに格納します。

- はじめに、Home ディレクトリにある「airflow」フォルダに移動します。その中に新しいディレクトリを作成し、タイトルを「dags」とします。 ここに、UI に表示されるAirflow のDAG を構築するPython ファイルを格納します。

- 次に新しいPython ファイルを作成し、タイトルをpipedrive_hook.py にします。この新規ファイル内に、次のコードを挿入します。

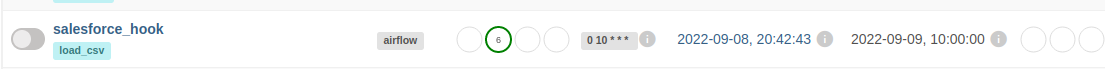

import time from datetime import datetime from airflow.decorators import dag, task from airflow.providers.jdbc.hooks.jdbc import JdbcHook import pandas as pd # Dag の宣言 @dag(dag_id="pipedrive_hook", schedule_interval="0 10 * * *", start_date=datetime(2022,2,15), catchup=False, tags=['load_csv']) # Dag となる関数を定義(取得するテーブルは必要に応じて変更してください) def extract_and_load(): # Define tasks @task() def jdbc_extract(): try: hook = JdbcHook(jdbc_conn_id="jdbc") sql = """ select * from Account """ df = hook.get_pandas_df(sql) df.to_csv("/{some_file_path}/{name_of_csv}.csv",header=False, index=False, quoting=1) # print(df.head()) print(df) tbl_dict = df.to_dict('dict') return tbl_dict except Exception as e: print("Data extract error: " + str(e)) jdbc_extract() sf_extract_and_load = extract_and_load() - このファイルを保存し、Airflow インスタンスをリフレッシュします。DAG リストの中に、「pipedrive_hook」というタイトルの新しいDAG が表示されるはずです。

- このDAG をクリックし、新しく表示される画面で一時停止解除スイッチをクリックして青色にし、トリガー(=play)ボタンをクリックしてDAG を実行します。この操作で、pipedrive_hook.py ファイルのSQL クエリを実行し、結果をCSV としてコード内で指定したファイルパスにエクスポートします。

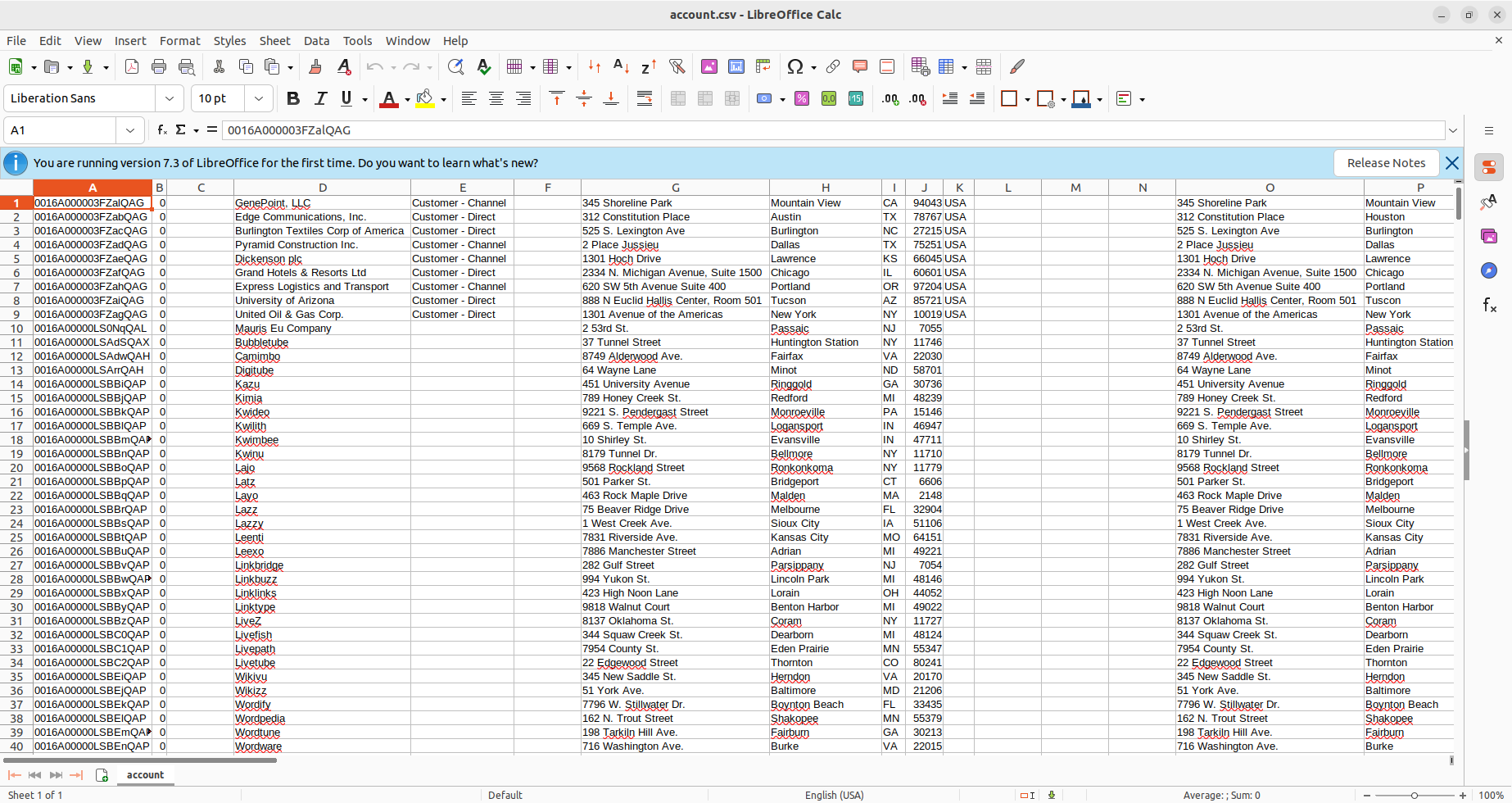

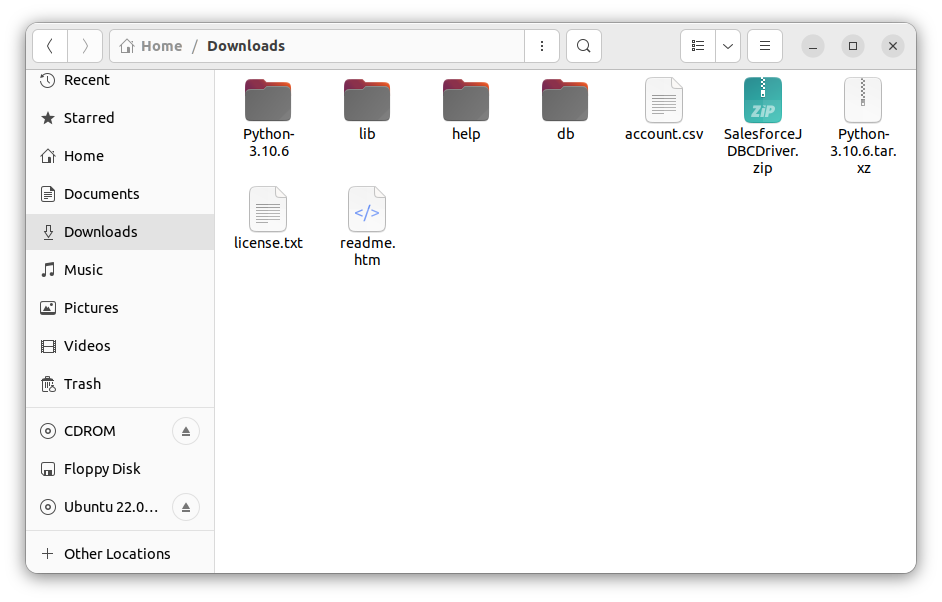

- 新規のDAG を実行後、Downloads フォルダ(またはPython スクリプト内で選択したフォルダ)を確認し、CSV ファイルが作成されていることを確認します(本ワークフローの場合はaccount.csv です)。

- CSV ファイルを開くと、Apache Airflow によってPipedrive のデータがCSV 形式で利用できるようになったことが確認できます。